#datatiede

Explore tagged Tumblr posts

Text

Miksi sivustoni nimi on datatiede?

Lyhyt vastaus: hakukoneoptimointi. Olen siirtymässä verkko-ohjelmoinnista datatieteen puolelle. Tahdon että blogini löytyy hakusanalla datatiede. Minut voi palkata datatiedeprojektiin osuuskuntamme kautta. Täytä kontaktisivulta löytyvä lomake ja lähetä se. Seuraavaksi pitkä vastaus. Edelliset sivuni olivat toiminimeäni varten, mutta ensimmäinen tuoteideani oli tehdä WooCommerceen…

View On WordPress

#BASIC#booksprint#DataCamp#datatiede#FLOSS Manuals#Helsingin Yliopisto#Indymedia#kehitysmaatutkimus#Netflix#NLP#O&039;Reilly#OpenCV#PHP#Python#Spacy#tilastotiede#valtiotieteiden maisteri#viestintä#WooCommerce

0 notes

Text

Ovatko algoritmit tasa-arvoisia?

Tässä blogitekstissä pohdin algoritmien ja tekoälyn käytön aiheuttamaa syrjintää. Tekoälyn käyttö on yleistynyt rekrytoinnin apuna. Tekoäly seuloo hakijoiden hakemukset ja CV:t rekrytoinnin ensimmäisessä vaiheessa. Osa hakijoista hylätään pelkästään sukupuolen perusteella. Onko tälläisen syrjinnän taustalla kuitenkin ihminen?

Algoritmit rekrytoinnin työkaluna

Yhä useampi yritys on ottanut rekrytoinneissaan avuksi tekoälyn. Tämä helpottaa rekrytoivaa yritystä huomattavasti, mikäli hakemuksia on paljon. Algoritmit eivät tee päätöksiä siitä kuka henkilö palkataan tehtävään, vaan ne vain avustavat rekrytointeja.

Amazon kokeili luoda rekrytointityökalun, jonka avulla palkattaisiin työntekijöitä teknisiin tehtäviin. Kokeilu epäonnistui, sillä tekoäly oppi hylkäämään naishakijoiden hakemuksia. Algoritmi oppi, että suurin osa Amazonin työntekijöistä on miehiä ja näin ollen oletti sen olevan yksi vaatimus tehtävässä menestymiseen. Tekoäly oppii mitä sille opetetaan ja minkälaisella datalla sitä .

Sanoisin, että Amazonin tapauksessa kyse oli ihmisten luomista ennakkoasenteista ja syrjinnän taustalla oli ihminen ei algoritmi. Tässä on vaarana myös rekrytoivan yrityksen kannalta se, että parasta hakijaa ei valita työhön, sillä hänet on hylätty sukupuolen tai muun tekoälyn oppiman asian perusteella. Eihän rekrytoiva henkilökään lähtökohtaisesti hylkää hakemusta hakijan taustan tai esim sukupuolen perusteella. Tuntuu oudolta, että tekoäly esimerkiksi saattaisi hylätä minun työhakemukseni jonkin sen oppiman asian takia.

Ihmisten asenteet taustalla

Jotta tekoälyn ja algoritmien aiheuttamaa syrjintää ei tapahtuisi on mielestäni ihmisten asenteita ja ennakkoluuloja muutettava. Kuten aiemmin todettu tekoäly oppii sen minkä sille opetetaan. Algoritmejä pystytään hyödyntämään maksimaalisella tavalla, kun niiden tekemät päätökset ovat reiluja.

Tietojenkäsittelytieteen apulaisprofessori Indre Žliobaitė tiivistää asian hyvin Helsingin yliopiston julkaisemassa artikkelissa – Datasta oppivat algoritmit oppivat sitä, mitä niille syötetään. Jos haluamme estää vinoumat, meidän pitää kääntää ihmisyhteisön moraaliset ja eettiset säännöt sekä merkitykset iän, etnisyyden, uskonnon ja sukupuolen takana matemaattisiksi rajoitteiksi ja opettaa ne päätöksenteossa käyttämillemme algoritmeille.

Aikaisemmin ajateltiin, että algoritmien tekemät päätökset ovat automaattisesti reiluja ja oikeita. Luulin itsekin näin ennen kuin tutustuin asiaan. Jopa koneoppimisen asiantuntijat uskoivat päätösten olevan reiluja. Nykyään ongelma tunnistetaan ja sitä tutkitaankin myös oikeudunmukaisen yhteiskunnan näkökulmasta, ei ainoastaan tekniikan näkökulmasta.

Vastausta siihen, että, saadaanko tähän asiaan koskaan ratkaisua ja päästäänkö tilanteeseen jossa algrotmien aiheuttamaa syrjintää ei tapahdu on vaikea antaa. – Ongelma on, että mikään data ei ole täydellistä. Se heijastelee aina yhteiskuntaa Indre Žliobaitė sanoo.

https://www.helsinki.fi/fi/uutiset/datatiede/algoritmi-syrjii-jos-data-ohjaa-sita-vaarin-tekoalylta-ei-silti-kannata-piilottaa-arkoja-asioita

https://yle.fi/uutiset/3-10222442

https://www.talouselama.fi/uutiset/amazon-paatti-lopettaa-tekoalyyn-perustuvan-kokeilunsa-havaittuaan-etta-se-syrji-naisia/a946332f-7f47-337c-bd34-86d35984210a

https://yle.fi/uutiset/3-10034072

2 notes

·

View notes

Text

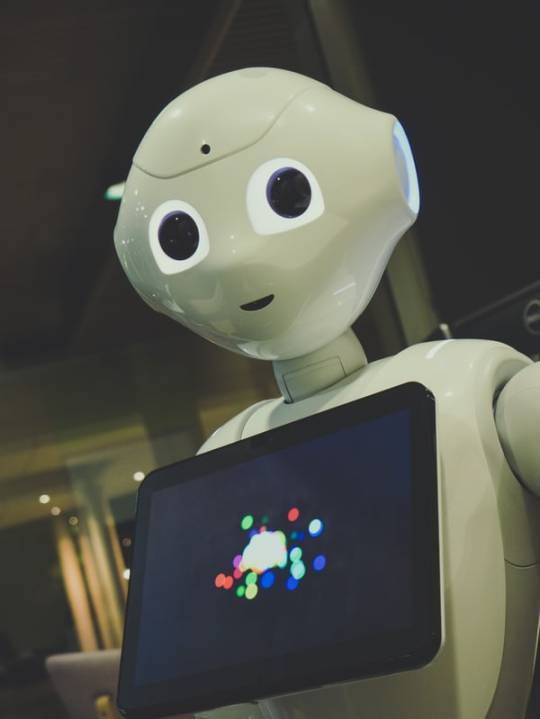

Tekoälyä, automatiikkaa ja robotteja

Melko scifiltä kuulostaa, eikö? Todellisuudessa lähes kaikki meistä ovat olleet tekemisissä ko. asioiden kanssa, mutta ehkä et ole edes miettinyt asiaa sillä hetkellä. Kuten personoidut mainokset tai uutiset. Pelottavaa? Ei, vaan normaalia nykypäivää jonka takana on tekoälyä tai ehkä tarkemmin algoritmeja.

Mikä tekoäly?

Tekoäly eli AI (Artificial Intelligence), tarkoittaa eri asioita riippuen siitä kuka sen määrittelee. Itewikin mukaan:

Tekoälyn eli keinoälyn (eng. artificial intelligence, myös lyhenne AI) määritelmä riippuu keskustelussa usein määrittelijästä, mutta itse asiassa edes tekoälyn tutkijoilla ei ole vielä sille vakiintunutta määritelmää. Tekoälyn voi kuitenkin nähdä olevan tiedesuuntaus, joka pyrkii tutkimaan älykkääseen toimintaan kykyneviä tietokoneita tai tietokoneohjelmia. Tutkijat ovat ottaneet tekoälyn määritelmässä avuksi kaksi seikkaa, jotka yhdistävät kaikkea tekoälyä: Autonomisuus: Kyky tehdä asioita ilman käyttäjän jatkuvaa avustamista. Adaptoituminen: Kyky kehittää toimintakykyä oppimisen kautta. Heikko tekoäly tarkoittaa tilannetta, jossa kone on opetettu ratkaisemaan yhtä ongelmaa. Se voi esimerkiksi personalisoida verkkosivujen sisällön tai tunnistaa ihmisen kasvojen perusteella. Kaikki nykyinen tekoäly kuuluu tähän kategoriaan. Vahvalla tekoälyllä viitataan koneisiin, jotka lähestyvät inhimillisen älykkyyden tasoa eli kykenevät tekemään asioita, joita ihminenkin. Vahvaa tekoälyä ei toistaiseksi ole kehitetty. (Itewiki) CGI:n sivuilta löytyy hyvin asiaa tekoälystä ja kaikkea digitalisaatioon liittyvää. Heidän mukaansa tekoälyksi voidaan määritellä ratkaisu, joka oppii ja kykenee ratkomaan ongelmia, jotka eivät ole ratkaistavissa rutiininomaisella laskennalla. Ratkaisu voi esimerkiksi sille opetettujen tapausten perusteella oppia tunnistamaan vakuutuspetokset tai rahanpesuyritykset tietyllä todennäköisyydellä. Liiketoiminnassa termiä tekoäly käytetään nykyään varsin huolettomasti, ja se voi tarkoittaa asiayhteydestä riippuen mitä tahansa edistynyttä analytiikan sovellusta, kuten ennakoivaa analytiikkaa, tekstianalytiikkaa tai visuaalista analytiikkaa. (Randén 2017)

Mihin tekoälyä ja automatiikkaa käytetään ja mitä hyötyä niistä on?

Itewiki sanoo tekoälyn sovelluskohteista: Tekoälyn läheisiä sovelluksia ovat koneoppiminen, syväoppiminen, datatiede sekä robotiikka. Tekoäly perustuu aina vähintään osittain todennäköisyyksiin. Sitä on mahdollista soveltaa liiketoiminnassa monilla eri aloilla esimerkiksi finanssialalla, markkinoinnissa, teollisuudessa ja lääketieteessä. Yksi tunnetuimmista tekoälyistä lienee Applen mobiililaitteiden assistentti Siri. Myös esimerkiksi verkkokauppajätti Amazonin toiminta perustuu pitkälle ennustaviin algoritmeihin, joiden avulla yritys pystyy analysoimaan sitä, mitä tietyn profiilin omaava asiakas seuraavaksi haluaisi ostaa. (Itewiki) Tekoäly ja automatiikka mahdollistavat esim. verkkokaupassa asioita joihin staattisilla verkkosivuilla ei ole mahdollisuuksia. Esimerkiksi tuotesuosittelut, ponnahdusikkunat ja verkkokaupan personointi. Myös markkinointi sähköpostilla tietylle ryhmälle asiakkaita tai muistutusviestit kesken jääneistä ostoista voidaan tehdä näitä hyödyntäen. Tehokkuus on enemmän rahaa. (Rikhard SDM)

Chatbotit eivät välttämättä liity tekoälyyn vaan perustuvat automaatioon, tästä on paljon harhakäsityksiä. Lue lisää täältä: https://finnchat.com/blogi/chatbot-ja-sen-eri-muotoja/

Miten robotit liittyvät mihinkään?

CGI:n sanakirjassa on selkeä selitys robotiikasta ja ohjelmistorobotiikasta sekä niiden suhteesta tekoälyyn. Robotiikalla voidaan tarkoittaa paitsi teollisuus- myös ohjelmistorobotteja. Robotit pääasiassa suorittavat orjallisesti niihin ohjelmoitua toimenpidesarjaa. Robotiikalla ei välttämättä ole mitään tekemistä tekoälyn kanssa, mutta robotit voivat toki käyttää tekoälypalveluita, esimerkiksi teollisuudessa konenäköä ja ohjelmistorobotiikassa teksti- ja kuva-analytiikkaa. (Randén 2017)

Eli siitä vaan miettimään uutisia lukiessa tai netissä shoppaillessa, että mitäs algoritmejä siellä mahtaakaan vilistä kun pop-upit ponnahtelee ja chat kysyy miten voi palvella.

Lähteet: Helsingin Yliopisto. Reaktor. Elements of AI. Luettavissa: https://course.elementsofai.com/fi/1/1. Luettu 27.9.2020. Itewiki. Digitaalisoinnin opas. Luettavissa: https://www.itewiki.fi/opas/tekoaly/. Luettu 27.9.2020. Randén, E 29.11.2017. CGI blogi. Pieni sanakirja tekoälystä. Luettavissa: https://www.cgi.fi/fi/blogi/pieni-sanakirja-tekoalysta. Luettu 27.9.2020. Rikhard. Suomen Digimarkkinointi. Blogi. Luettavissa: https://www.digimarkkinointi.fi/blogi/tekoaly-automaatio-verkkosivut. Luettu 27.9.2020.

0 notes

Text

OVATKO ALGORITMIT TASA-ARVOISIA?

Innostuin niin kovasti tekoälyaiheesta, että perehdyin kahteen aiheeseen tämän viikon blogeja varten.

Toisena aiheena tutustuin kirjoituksiin, joiden pääpointtina toimi havainto, että tekoälyn on huomattu syrjivän tiettyjä ryhmiä. Algoritmit ovat alkaneet tunnistamaan suoraan tai jopa hyvin epäsuorasti tiettyjä piirteitä ja tekemään päätöksiä sen perusteella. Esimerkkeinä toimii esimerkiksi asuinalueen tai etnisyyden vaikuttaminen velanmaksukykyyn tai sukupuolen vaikutus rekrytointiin.

Konkreettisena esimerkkinä toimii Amazon, joka teki rekrytointikokeilun tekoälyn avulla. Ennen pitkää huomattiin, että algoritmi väheksyi järjestelmällisesti naispuolisten hakijoiden CV:itä. Algoritmin toiminta perustui dataan, jota on kerätty valtava määrä edellisistä rekrytointiprosesseista. Syy naishakijoiden syrjintään oli yksinkertaisuudessaan se, että Amazonilla on vain hyvin vähän naisia töissä, jolloin algoritmi oletti automaattisesti miehen sukupuolen olevan menestystekijä.

Teksteissä pohdittiin, miten tästä ongelmasta voisi päästä eroon. Itse aihe on todella mielenkiintoinen ja olisin voinut lukea siitä vaikka kuinka paljon, mutta huomioni kiinnitti kuitenkin täysin muu asia; nimittäin se, että kahdessa lukemassani artikkelissa oli täysin vastakkaisia tietoja syrjintäongelman ratkaisemiseksi.

Helsingin yliopiston artikkelissa oli löydetty ratkaisu syrjivään tekoälyyn. Ratkaisuksi kerrottiin se, että algoritmista ei saa poistaa syrjiviä arvoja, kuten sukupuolta tai etnisyyttä. Tiedon poistaminen ei vaikuttaisi lopputulokseen, sillä algoritmi osaa päätellä syrjiviä elementtejä epäsuorasti montaa muuta reittiä, kuten sanavalinnan tai muun vihjeen kautta. ”Sukupuolen tai etnisyyden kaltaisten asioiden piilottaminen datasta voi itse asiassa huonontaa tilannetta”, sanoo asiantuntija Zliobaite. Syrjivän tiedon poistamisen sijaan algoritmille tulisi antaa kaikki mahdollinen tieto, myös syrjintää tuottavat tiedot, mutta kouluttaa algoritmia alkumetreiltä lähtien ja poistaa signaaleja, jotka johtavat syrjimiseen. Algoritmin alusta alkaen opettaminen oikeisiin arvoihin on ainoa keino saada algoritmi sisäistämään arvoja ja rakennuttaa ne algoritmin sisään.

Ylen artikkelissa oli taas löydetty syrjimisongelmaan täysin päinvastainen ratkaisu. Artikkelissa kerrotaan, miten tekoälyn syrjimisen ratkaisuksi yritys poistaa kaikki syrjimiseen johtavat tiedot. ”Me poistamme osoitteen, nimen, henkilötiedot, sukupuolen ja iän väärien korrelaatioiden välttämiseksi. Työnhakijan muut CV:ssä ilmoittamat tiedot ovat tärkeimmät”, Kirsi Louhelainen sanoo. Tämä keino edellisen artikkelin mukaan olisi pitkällä aikavälillä todella väärä, sillä syrjiviä arvoja ei opeteta algoritmille vaan ne suljetaan siltä kokonaan pois, mutta algoritmi saa korreloitua syrjivät arvot muiden tietojen kautta.

Näkökulmastani tämä on juuri SE ongelma, jota tekoäly tuo tullessaan. Ihmiset eivät ymmärrä tekoälyn ja algoritmien pohjimmaista toimintatapaa ja tekevät täten eriäviä ja virheellisiä toimintapäätöksiä. Tämä saattaa taas Ylen artikkelin esimerkissä johtaa jatkossa siihen, että algoritmi osaa päätellä puuttuvat tiedot epäsuoraa kautta, jolloin algoritmin lopputulemaan vaikuttavia tekijöitä on vaikeampi tunnistaa ja tätä myötä myös mahdollista jatkuvaa syrjintää ei huomata.

Kiitos kun luit, XOXO Idu <3

Lähteet: https://www.helsinki.fi/fi/uutiset/datatiede/algoritmi-syrjii-jos-data-ohjaa-sita-vaarin-tekoalylta-ei-silti-kannata-piilottaa-arkoja-asioitahttps://yle.fi/uutiset/3-10034072https://www.talouselama.fi/uutiset/amazon-paatti-lopettaa-tekoalyyn-perustuvan-kokeilunsa-havaittuaan-etta-se-syrji-naisia/a946332f-7f47-337c-bd34-86d35984210a

0 notes

Text

Ovatko algoritmit tasa-arvoisia?

Teknologiajätti ja tekoälyn edelläkävijä Amazon uutisoi alkuvuonna lopettavansa kokeellisen tekoälyyn perustuvan rekrytointityökalunsa käyttämisen, sillä sen havaittiin järjestelmällisesti väheksyvän naishakijoiden CV:itä (Lavancy 2019). Tekoälyn käyttämisen rekrytointiprosessissa voisi kuvitella vähentävän syrjimistä tai hakijoiden epätasa-arvoista kohtelua. Roboteilla ei pitäisi olla ihmisten kaltaisia ennakkoluuloja, jotka ohjaisivat niiden päätöksentekoa. Miksi kuitenkin tarkemmin tarkasteltuna Amazonin tekoälykokeilusta rekrytointiprosessista löytyi puutteita tasa-arvosta?

(Kuvan lähde: https://www.uusiteknologia.fi/2017/03/28/algoritmit-tuovat-apua-katso-videolta/.)

Tekoäly ja algoritmit lisäävät tehokkuutta ja helpottavat rekrytointiprosessia. Ongelmaksi muodostuu kuitenkin se, että ne jäljittelevät ihmisten ennakkoasenteita, sillä niiden alkuperäinen data on ihmisen luomaa. Amazonin rekrytointiprosessissa tekoäly löysi korrelaation työpaikan miesvaltaisuudelle, jonka oletti olevan yksi alalla menestymiseen johtava tekijä. Tästä syystä se järjestelmällisesti syrji naishakijoita prosesseissaan. (Lavancy 2019.)

Helsingin Yliopiston apulaisprofessori Indrè Zliobaitén mukaan tekoälyä on opetettu vinoumia sisältävällä datalla, joka heijastelee aina yhteiskuntaa (Pekkarinen 2018). Tämän takia yleinen olettamus siitä, että tekoäly toimii aina objektiivisesti ja täysin vailla ihmisten ennakkoasenteita ja -olettamuksia, ei kuitenkaan pidä aivan paikkaansa.

Kotimainen henkilöstöpalveluyritys Barona Technologies käyttää tekoälyä ”tukiälynä” prosesseissaan, mutta ei korvaa sillä täysin ihmistä. Baronan teknologiapäällikkö Kirsi Louhelainen kertoo, ettei tekoäly ei tee valintapäätöksiä, vaan se ainoastaan avustaa rekrytointeja. Louhelaisen mukaan tekoälyn käsittelemästä datasta tulisi poistaa mahdolliset demografiset tekijät, kuten ikä tai sukupuoli, sillä nämä eivät saisi vaikuttaa päätöksentekoon rekrytoinneissa. Tekoäly voi löytää päätöksentekoaan ohjaamaan heikonkin korrelaation mistä vain, esimerkiksi posti- tai talonnumerosta. (Hakkarainen 2018.)

New York University:n tekemän mielenkiintoisen tutkimuksen (West, Whittaker, Crawford 2019, s.3) mukaan tekoälyn alan huippuosaajista vain noin 18 prosenttia on naisia, kun taas teknologiajätti Googlella työskentelevistä alan osaajista naisia on vain noin 10 prosenttia. Valtaosa tekoälyn kehittäjistä ja ohjelmoijista on valkoihoisia miehiä, mikä voi osaltaan vaikuttaa tekoälyssä ilmenneisiin puutteisiin tasa-arvossa. Tulevaisuudessa alalle tarvitaan mielestäni ehdottomasti enemmän naisosaajia, jotka voivat omalta osaltaan olla kehittämässä ja mahdollistamassa tasa-arvoisempaa tekoälyä.

Kaikki tekoälyn suorittama erottelu ei kuitenkaan onneksi ole syrjivää, kuten esimerkiksi suoratoistopalvelu Netflixin käyttämät algoritmit, jotka suosittelevat käyttäjille TV-ohjelmia sekä elokuvia katsottavaksi (Pekkarinen 2018). Tämän kaltaisessa erottelussa on tavoitteena palvella asiakasta sekä tuottaa lisäarvoa, jossa olennaista on, että ihmisten välille saadaan eroja. Muutenhan Netflix suosittelisi kaikille käyttäjilleen täysin samoja asioita!

Tekoälyn kehittyminen tällä hetkellä on niin nopeaa, että ongelmien ja epäkohtien havaitseminen ja niihin puuttuminen laahaa valitettavasti hieman jäljessä, kuten tässäkin tapauksessa. Vastauksena otsikon kysymykseen voisi todeta, että algoritmit ovat tasa-arvoisia - toivottavasti tulevaisuudessa!

Lähteet

Hakkarainen, J. 2018. Lisääntyykö syrjintä työnhaussa? Tekoäly seuloo entistä useammin hyvät akanoista. Artikkeli 22.1.2018. YLE. Luettavissa: https://yle.fi/uutiset/3-10034072. Luettu 11.11.2019.

Lavanchy, M. 2019. Amazon päätti lopettaa tekoälyyn perustuvan kokeilunsa havaittuaan, että se syrji naisia. Blogikirjoitus 9.3.2019. Talouselämä. Luettavissa: https://www.talouselama.fi/uutiset/amazon-paatti-lopettaa-tekoalyyn-perustuvan-kokeilunsa-havaittuaan-etta-se-syrji-naisia/a946332f-7f47-337c-bd34-86d35984210a. Luettu: 11.11.2019.

Pekkarinen, A. 2018. Algoritmi syrjii, jos data ohjaa sitä väärin – tekoälyltä ei silti kannata piilottaa arkoja asioita. Tiedote 7.9.2018. Helsingin Yliopisto. Luettavissa: https://www.helsinki.fi/fi/uutiset/datatiede/algoritmi-syrjii-jos-data-ohjaa-sita-vaarin-tekoalylta-ei-silti-kannata-piilottaa-arkoja-asioita. Luettu: 11.11.2019.

West, S.M., Whittaker, M., Crawford, K. 2019. DISCRIMINATING SYSTEMS: Gender, Race, and Power in AI. AI Now Institute. Luettavissa: https://ainowinstitute.org/discriminatingsystems.pdf. Luettu: 12.11.2019.

0 notes

Text

Ovatko algoritmit tasa-arvoisia?

Miten algoritmit, filtterikuplat tai kaikukammio vaikuttavat meille tarjottuun tietoon. Mitä ongelmia näistä saattaa seurata?

Algoritmien syrjintä

Yhtenä suurimmista tekoälyyn liittyvistä ongelmista pidetään algoritmien toisinaan aiheuttamaa syrjintää. Yleinen uskomus on, että algoritmien tekemät päätökset ovat automaattisesti objektiivisia ja reiluja. Totuus kuitenkin on että algoritmit voivat omaksua ennakkoasenteita tahattomastikin useistakin eri lähteistä. Jos datassa jostain syystä on minkäänlainen epäsuorakin linkki kahden asian välillä, algoritmi poimii tämän signaalin, ellei sitä ole opetettu toisin.

Esimerkki 1: Amazon, tekoälyteknologian edelläkävijä, ei onnistunut tekemään kokeellisen rekrytointityökalunsa algoritmista sukupuolineutraalia. Yhtiö loi työkalun voidakseen löytää verkosta tekijöitä teknisiin tehtäviin, kuten ohjelmistokehittäjiksi. Amazonin tapauksessa algoritmi opetteli tunnistamaan parhaat ehdokkaat kaikkien yhtiölle kymmenen vuoden aikana lähetettyjen CV:iden perusteella. Amazonissa, kuten useissa teknologiayhtiöissä naisia on henkilöstössä vähän. Algoritmi tunnisti nopeasti miesten hallitsevuuden ja oletti sen olevan yksi menestystekijöistä, ja näin ollen oppi väheksymään järjestelmällisesti naishakijoiden CV:itä.

Esimerkki 2: Algoritmeja käytetään lainansaannin ja maksukyvyn arvioimiseen. Alueella, jolla tulotaso on keskimääräistä heikompi ja tietty kansallisuus sattuu olemaan yleinen, algoritmi alkaa nähdä korrelaatiota näiden asioiden välillä. Se päättelee, että tiettyä kansallisuutta olevat ihmiset ovat muita todennäköisemmin pienituloisia, ja tästä johtuen voi vaikka evätä lainan saannin.

Ihminen voi päättää olla antamatta tiettyjen ominaisuuksien vaikuttaa päätöksen tekoon, mutta algoritmit ei. Niidenkin päätökset kuitenkin heijastuu yhteiskunnasta ja meistä itsestämme. Datasta oppivat algoritmit oppivat sitä, mitä niille syötetään. Meidän pitäisi ratkaista mitä ominaisuuksia päätöksenteossa saa katsoa ja missä määrin, ja kääntää ihmisyhteisön moraaliset ja eettiset säännöt sekä merkitykset iän, etnisyyden, uskonnon tai sukupuolen takana matemaattisiksi rajoitteiksi, ja opettaa ne algoritmeille.

Filtterikupla ja kaikukammio

Algoritmit vaikuttavat suuresti meille tarjottuun tietoon. Sosiaalisen median toimijat, kuten Google ja Facebook ajavat käyttäjiä ”harhaan” algoritmeillaan. Mitä enemmän klikkaat, seuraat tai tykkäät jotakin asiaa, sitä enemmän nämä nettimediat syöttävät ja suosittelevat sinulle samanlaista sisältöä. Näiden tietojen perusteella sinut profiloidaan, ja näitä tietoja käytetään mainosten suuntaamiseen tai hakutulosten järjestykseen, kaikkeen tietoon jonka saat. Näet siis vain algoritmien suodattaman sisällön. Näin käyttäjä eristyy tahattomasti omaan kuplaansa, jota kutsutaan filtterikuplaksi.

Kupla ilmenee käytännössä monella tavalla. Googlessa esimerkiksi hakutulokset ovat erilaisia, riippuen riitä kuka hakee. Myös esimerkiksi Facebook suodattaa julkaisuja pohjautuen aiempiin tykkäyksiin ja jakoihin. Saamme vain samanlaista sisältöä lisää, emmekä mitään uutta tai yllättävää. Tätä kutsutaan myös kaikukammio efektiksi.

Nykyään esimerkiksi Netflix ei näytä elokuva- ja sarjasuosituksissa ainoastaan mieltymyksiemme mukaisia suosituksia, vaan se vertaa ihmisten makua muiden makuun ja päättelee, mihin suuntiin heidän makuaan ja mieltymysten reunamia voisi yrittää laajentaa. Tästä voisi monet verkkopalvelut ottaa mallia.

Ongelmaksi muodostuu se, että monet ihmiset eivät ymmärrä tai tiedä sitä, että se mitä netissä näemme on suodatettua, eikä siinä oikeasti ole kaikki mitä on. Pelätään, että ihmisten maailmankatsomus kapenee, kun nähdään vaan omien mieltymysten mukaista sisältöä.

Lähteet

https://www.helsinki.fi/fi/uutiset/datatiede/algoritmi-syrjii-jos-data-ohjaa-sita-vaarin-tekoalylta-ei-silti-kannata-piilottaa-arkoja-asioita

https://yle.fi/uutiset/3-10034072

https://www.talouselama.fi/uutiset/amazon-paatti-lopettaa-tekoalyyn-perustuvan-kokeilunsa-havaittuaan-etta-se-syrji-naisia/a946332f-7f47-337c-bd34-86d35984210a

https://www.tekniikkatalous.fi/uutiset/kaikukammio-ongelma-vaivaa-sosiaalisia-verkkopalveluita-nain-netflix-haluaa-laajentaa-kayttajien-makua/dc807a58-7f09-30a7-806f-f54be008e067

https://www.modulcon.fi/2018/01/17/elatko-kuplassa/

https://www.opettaja.fi/tyossa/opettaja-nain-tarkistat-faktat-verkossa/

0 notes

Link

“Tietojenkäsittelytiede on maailman nopeimmin kehittyvä ala, Se on luonnontiede, jonka pyrkimyksenä on valjastaa tietokoneet ihmiskunnan eduksi. Tietojenkäsittelytieteen opiskelijana perehdyt ensin ohjelmointiin ja matematiikkaan tai menetelmätieteeseen ja määrittelet sitten oman erikoistumislinjasi kautta sen, miten haluavat olla mukana helpottamassa ihmisten elämää tietoteknisten ratkaisujen avulla.Erikoistumislinjat ovat: bioinformatiikka, algoritmit ja koneoppiminen, hajautetut järjestelmät ja tietoliikenne sekä ohjelmistojärjestelmät.“

0 notes