#googlenet

Explore tagged Tumblr posts

Text

GoogleNet: Cột mốc đột phá trong lĩnh vực trí tuệ nhân tạo

🌐 GoogleNet: Cột mốc đột phá trong lĩnh vực trí tuệ nhân tạo 🤖

Bạn đã bao giờ nghe về GoogleNet chưa? 🌟 Đây là một trong những bước tiến vượt bậc trong AI, mở ra những khả năng không tưởng cho việc nhận diện hình ảnh 📸, hiểu ngữ cảnh 📊 và học máy. GoogleNet không chỉ là một mô hình mạng nơ-ron đơn thuần mà còn là công nghệ làm thay đổi cách chúng ta tương tác với dữ liệu và thông tin! 🚀

👉 Khám phá ngay bài viết chi tiết để hiểu thêm về cách GoogleNet đang làm thay đổi tương lai của công nghệ AI! GoogleNet: Cột mốc đột phá trong lĩnh vực trí tuệ nhân tạo

Khám phá thêm những bài viết giá trị tại aicandy.vn

1 note

·

View note

Text

Danh sách bài viết trên AIcandy.vn

Học tập toàn diện: Kết nối lý thuyết, thực hành và dữ liệu thực tế

Kiến thức nền tảng trí tuệ nhân tạo

Trí tuệ nhân tạo (AI): Lịch sử phát triển và ứng dụng thực tiễn

Từ điển AI cho người mới bắt đầu: Giải thích các khái niệm chính

Khám phá sự khác biệt giữa AI, ML và DL

Tổng quan 4 phương pháp học máy chính trong trí tuệ nhân tạo

Hồi quy tuyến tính: Kỹ thuật cơ bản và ứng dụng trong học máy

K-Means Clustering: Ưu điểm, nhược điểm và khi nào nên sử dụng

Khám phá K-nearest neighbors cho phân loại và hồi quy

Phân loại dữ liệu là gì? Giải thích đơn giản và ví dụ thực tế

Random Forest: Giải thích chi tiết và ứng dụng

SVM trong xử lý dữ liệu phi tuyến tính: Kỹ thuật kernel và ứng dụng

Mạng nơ-ron nhân tạo: Công nghệ đột phá trong trí tuệ nhân tạo

Convolutional Neural Networks (CNN) trong Deep Learning

Recurrent Neural Network (RNN): Ứng dụng và cách hoạt động

Tăng tốc huấn luyện mô hình với phương pháp Gradient Descent

Các phương pháp đánh giá hiệu suất mô hình Machine Learning

Tìm hiểu phân loại hình ảnh trong AI: Cách thức và ứng dụng

Tìm hiểu nhận diện đối tượng trong AI: Cách thức và ứng dụng

Xử lý ngôn ngữ tự nhiên: Công nghệ phân tích ngôn ngữ bằng AI

Giới thiệu chi tiết về học tăng cường: Phương pháp và ứng dụng

MobileNet: Mô hình hiệu quả trên thiết bị di động

Mô hình ResNet: Đột phá trong nhận diện hình ảnh

SSD: Giải pháp hiệu quả cho bài toán phát hiện đối tượng

EfficientNet: Cách mạng hóa mạng neural hiện đại

DenseNet: Cấu trúc, nguyên lý và ưu điểm trong mạng nơ-ron sâu

Tìm hiểu mô hình YOLOv5: Hiệu quả trong nhận diện đối tượng

YOLOv8: Nhận diện đối tượng với hiệu suất vượt trội

RetinaNet: Cải tiến mạnh mẽ trong công nghệ phát hiện đối tượng

GoogleNet: Cột mốc đột phá trong lĩnh vực trí tuệ nhân tạo

AlexNet: Bước đột phá trong trí tuệ nhân tạo

Tìm hiểu mô hình FaceNet cho bài toán nhận diện khuôn mặt

Imbalanced Dataset: Thách thức và giải pháp trong Machine Learning

PyTorch trong học máy cho người mới bắt đầu

Từ lý thuyết đến thực hành AI-ML

Ứng dụng mạng MobileNet vào phân loại hình ảnh

Ứng dụng mạng GoogleNet vào phân loại hình ảnh

Ứng dụng mạng DenseNet vào phân loại hình ảnh

Ứng dụng mạng AlexNet vào phân loại hình ảnh

Ứng dụng mạng Efficientnet vào phân loại hình ảnh

Ứng dụng mạng ResNet-18 vào phân loại hình ảnh

Ứng dụng mạng ResNet-50 vào phân loại hình ảnh

Hướng dẫn chi tiết cách huấn luyện dữ liệu tùy chỉnh với YOLO5

Hướng dẫn chi tiết cách huấn luyện dữ liệu tùy chỉnh với YOLO8

Ứng dụng mạng SSD300 vào nhận diện đối tượng

Ứng dụng mạng RetinaNet vào nhận diện đối tượng

Cách dự đoán giá cổ phiếu hiệu quả bằng mô hình LSTM

Ứng dụng Machine Learning vào chơi game Flappy Bird

Triển khai phân loại hình ảnh trên thiết bị Android

Triển khai nhận diện đối tượng trên thiết bị Android với YOLO

Hướng dẫn triển khai phân loại hình ảnh trên Website miễn phí

Kho dữ liệu dành cho học máy

Tổng hợp công cụ hỗ trợ phát triển AI, ML, DL

1 note

·

View note

Text

Learning from imbalanced data paper review

A review of novelty detection

DenseNet

World Models

Zero-shot Learning Through Cross-Modal Transfer

Layer Normalization

Dropout: A Simple Way to Prevent Neural Networks from Overfitting

Human level control through deep reinforcement learning (DQN)

Representation Learning:A Review and New Perspectives

Simple and Scalable Predictive Uncertainty Estimation using Deep Ensembles

Neural Machine Translation by Jointly Learning to Align and Translate

Effective Approaches to Attention-based Neural Machine Translation

GoogLeNet

Improving Language Understanding by Generative Pre-Training

Deep Learning Model for Anomaly Detection: Survey

A Neural Attention Model for Abstractive Sentence Summarization

LSTM: A Search Space Odyssey

Isolation-based Anomaly Detection

An overview of gradient descent optimization algorithms

0 notes

Text

Looked up a word on the googlenet for a Zhuzhi-lang comment because I forgot the word for snek science and

have been reminded how creepy that book of faces is (even though I do like this post, and also librarians, and also sneks, and you know what? snacks too)

1 note

·

View note

Video

vimeo

Cronenberg - POD Wants To Know You - ANN/DD inceptionism from denial of service on Vimeo.

David Cronenberg's POD, the ultimate recommendation engine - as dreamt by the lysergic machine.

thecreatorsproject.vice.com/blog/deepdreamed-cronenberg-is-the-cronenberg-of-deepdreaming

Artificial Neural Network / quasi-guided Deep Dreaming cycling through all available salience layers & utilising the standard reference ImageNet-trained GoogLeNet model (Caffe Model Zoo - github.com/BVLC/caffe/wiki/Model-Zoo) / 8 iterations / 32 jtr / 5 octaves / looped blending. /git: 2_dreaming_time / github.com/graphific/DeepDreamVideo

"POD (Personal On-demand) is an emotional sensory learning and data-mining organism designed to enhance your life. This state of the art biotech implant will guarantee you personalized recommendations that are 99.999% relevant all the time. POD grows with you to become an intuitive companion, fulfilling your deepest desires on demand"

bodymindchange.ca facebook.com/bodymindchange twitter.com/bodymindchange

©2015 BMC LABS | POD IS A BMC LABS PRODUCT

original presentation video > vimeo.com/97341182 youtube.com/watch?v=VAopifw3c9U

0 notes

Text

CNN Computer vision

This article explains popular CNN Architectures specific to object recognition. If you are new you should go through Computer vision basics first.

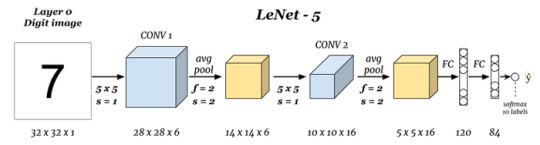

LeNet-5 architecture

One of the earliest CNN archietctures created by Yann LeCun in 1998. It was used for written digits recignition using MNIST database.

Starts with grayscalling images of 32x32x1 shape and applied with six 5×5 filters CONV…

View On WordPress

#AlexNet#CNN Architetures#Computervision#Fast R-CNN#GoogleNet#Inception#LeNet#Object Classification#Object Recognition#R-CNN#ResNET#VGG16#YOLO

0 notes

Photo

New hi-res deepdraw images: soon to be posted at @neuralgae

1 note

·

View note

Text

밑바닥부터 시작하는 딥러닝 1 사이토 고키

1장 헬로 파이썬 1.1 파이썬이란? 1.2 파이썬 설치하기 __1.2.1 파이썬 버전 __1.2.2 사용하는 외부 라이브러리 __1.2.3 아나콘다 배포판 1.3 파이썬 인터프리터 __1.3.1 산술 연산 __1.3.2 자료형 __1.3.3 변수 __1.3.4 리스트 __1.3.5 딕셔너리 __1.3.6 bool __1.3.7 if 문 __1.3.8 for 문 __1.3.9 함수 1.4 파이썬 스크립트 파일 __1.4.1 파일로 저장하기 __1.4.2 클래스 1.5 넘파이 __1.5.1 넘파이 가져오기 __1.5.2 넘파이 배열 생성하기 __1.5.3 넘파이의 산술 연산 __1.5.4 넘파이의 N차원 배열 __1.5.5 브로드캐스트 __1.5.6 원소 접근 1.6 matplotlib __1.6.1 단순한 그래프 그리기 __1.6.2 pyplot의 기능 __1.6.3 이미지 표시하기 1.7 정리 2장 퍼셉트론 2.1 퍼셉트론이란? 2.2 단순한 논리 회로 __2.2.1 AND 게이트 __2.2.2 NAND 게이트와 OR 게이트 2.3 퍼셉트론 구현하기 __2.3.1 간단한 구현부터 __2.3.2 가중치와 편향 도입 __2.3.3 가중치와 편향 구현하기 2.4 퍼셉트론의 한계 __2.4.1 도전! XOR 게이트 __2.4.2 선형과 비선형 2.5 다층 퍼셉트론이 출동한다면 __2.5.1 기존 게이트 조합하기 __2.5.2 XOR 게이트 구현하기 2.6 NAND에서 컴퓨터까지 2.7 정리 3장 신경망 3.1 퍼셉트론에서 신경망으로 __3.1.1 신경망의 예 __3.1.2 퍼셉트론 복습 __3.1.3 활성화 함수의 등장 3.2 활성화 함수 __3.2.1 시그모이드 함수 __3.2.2 계단 함수 구현하기 __3.2.3 계단 함수의 그래프 __3.2.4 시그모이드 함수 구현하기 __3.2.5 시그모이드 함수와 계단 함수 비교 __3.2.6 비선형 함수 __3.2.7 ReLU 함수 3.3 다차원 배열의 계산 __3.3.1 다차원 배열 __3.3.2 행렬의 내적 __3.3.3 신경망의 내적 3.4 3층 신경망 구현하기 __3.4.1 표기법 설명 __3.4.2 각 층의 신호 전달 구현하기 __3.4.3 구현 정리 3.5 출력층 설계하기 __3.5.1 항등 함수와 소프트맥스 함수 구현하기 __3.5.2 소프트맥스 함수 구현 시 주의점 __3.5.3 소프트맥스 함수의 특징 __3.5.4 출력층의 뉴런 수 정하기 3.6 손글씨 숫자 인식 __3.6.1 MNIST 데이터셋 __3.6.2 신경망의 추론 처리 __3.6.3 배치 처리 3.7 정리 4장 신경망 학습 4.1 데이터에서 학습한다! __4.1.1 데이터 주도 학습 __4.1.2 훈련 데이터와 시험 데이터 4.2 손실 함수 __4.2.1 평균 제곱 오차 __4.2.2 교차 엔트로피 오차 __4.2.3 미니배치 학습 __4.2.4 (배치용) 교차 엔트로피 오차 구현하기 __4.2.5 왜 손실 함수를 설정하는가? 4.3 수치 미분 __4.3.1 미분 __4.3.2 수치 미분의 예 __4.3.3 편미분 4.4 기울기 __4.4.1 경사법(경사 하강법) __4.4.2 신경망에서의 기울기 4.5 학습 알고리즘 구현하기 __4.5.1 2층 신경망 클래스 구현하기 __4.5.2 미니배치 학습 구현하기 __4.5.3 시험 데이터로 평가하기 4.6 정리 5장 오차역전파법 5.1 계산 그래프 __5.1.1 계산 그래프로 풀다 __5.1.2 국소적 계산 __5.1.3 왜 계산 그래프로 푸는가? 5.2 연쇄법칙 __5.2.1 계산 그래프에서의 역전파 __5.2.2 연쇄법칙이란? __5.2.3 연쇄법칙과 계산 그래프 5.3 역전파 __5.3.1 덧셈 노드의 역전파 __5.3.2 곱셈 노드의 역전파 __5.3.3 사과 쇼핑의 예 5.4 단순한 계층 구현하기 __5.4.1 곱셈 계층 __5.4.2 덧셈 계층 5.5 활성화 함수 계층 구현하기 __5.5.1 ReLU 계층 __5.5.2 Sigmoid 계층 5.6 Affine/Softmax 계층 구현하기 __5.6.1 Affine 계층 __5.6.2 배치용 Affine 계층 __5.6.3 Softmax-with-Loss 계층 5.7 오차역전파법 구현하기 __5.7.1 신경망 학습의 전체 그림 __5.7.2 오차역전파법을 적용한 신경망 구현하기 __5.7.3 오차역전파법으로 구한 기울기 검증하기 __5.7.4 오차역전파법을 사용한 학습 구현하기 5.8 정리 6장 학습 관련 기술들 6.1 매개변수 갱신 __6.1.1 모험가 이야기 __6.1.2 확률적 경사 하강법(SGD) __6.1.3 SGD의 단점 __6.1.4 모멘텀 __6.1.5 AdaGrad __6.1.6 Adam __6.1.7 어느 갱신 방법을 이용할 것인가? __6.1.8 MNIST 데이터셋으로 본 갱신 방법 비교 6.2 가중치의 초깃값 __6.2.1 초깃값을 0으로 하면? __6.2.2 은닉층의 활성화 분포 __6.2.3 ReLU를 사용할 때의 가중치 초깃값 __6.2.4 MNIST 데이터셋으로 본 가중치 초깃값 비교 6.3 배치 정규화 __6.3.1 배치 정규화 알고리즘 __6.3.2 배치 정규화의 효과 6.4 바른 학습을 위해 __6.4.1 오버피팅 __6.4.2 가중치 감소 __6.4.3 드롭아웃 6.5 적절한 하이퍼파라미터 값 찾기 __6.5.1 검증 데이터 __6.5.2 하이퍼파라미터 최적화 __6.5.3 하이퍼파라미터 최적화 구현하기 6.6 정리 7장 합성곱 신경망(CNN) 7.1 전체 구조 7.2 합성곱 계층 __7.2.1 완전연결 계층의 문제점 __7.2.2 합성곱 연산 __7.2.3 패딩 __7.2.4 스트라이드 __7.2.5 3차원 데이터의 합성곱 연산 __7.2.6 블록으로 생각하기 __7.2.7 배치 처리 7.3 풀링 계층 __7.3.1 풀링 계층의 특징 7.4 합성곱/풀링 계층 구현하기 __7.4.1 4차원 배열 __7.4.2 im2col로 데이터 전개하기 __7.4.3 합성곱 계층 구현하기 __7.4.4 풀링 계층 구현하기 7.5 CNN 구현하기 7.6 CNN 시각화하기 __7.6.1 1번째 층의 가중치 시각화하기 __7.6.2 층 깊이에 따른 추출 정보 변화 7.7 대표적인 CNN __7.7.1 LeNet __7.7.2 AlexNet 7.8 정리 8장 딥러닝 8.1 더 깊게 __8.1.1 더 깊은 네트워크로 __8.1.2 정확도를 더 높이려면 __8.1.3 깊게 하는 이유 8.2 딥러닝의 초기 역사 __8.2.1 이미지넷 __8.2.2 VGG __8.2.3 GoogLeNet __8.2.4 ResNet 8.3 더 빠르게(딥러닝 고속화) __8.3.1 풀어야 할 숙제 __8.3.2 GPU를 활용한 고속화 __8.3.3 분산 학습 __8.3.4 연산 정밀도와 비트 줄이기 8.4 딥러닝의 활용 __8.4.1 사물 검출 __8.4.2 분할 __8.4.3 사진 캡션 생성 8.5 딥러닝의 미래 __8.5.1 이미지 스타일(화풍) 변환 __8.5.2 이미지 생성 __8.5.3 자율 주행 __8.5.4 Deep Q-Network(강화학습) 8.6 정리 부록 A Softmax-with-Loss 계층의 계산 그래프 A.1 순전파 A.2 역전파 A.3 정리 참고문헌

2 notes

·

View notes

Photo

Remember in the movie i, Robot when the center chest lights turned red it meant they were about to go ratchet on the humans around them? I've only had #SkyNet mini here, turned on, for 24 hours and I already pissed it off. Well, it was fun while it lasted. I'll be in my bunker if you need me. 😅😂#GoogleNet #ResistanceIsFutile (at Studio City, California)

0 notes

Photo

Computer Diagnoses Skin #Cancers Researchers have developed an #algorithm that recognizes #skincancer in #photos about as well as #dermatologists do. So says a study published today in #Nature. The algorithm, developed by a group at #Stanford #University, is not the first automated system for recognizing #skinlesions, but it’s likely the most robust, the researchers say. “This is like when a computer first beat the world champion chess player,” says Sancy Leachman, a #dermatologist and researcher at Oregon #Health & #Science University who was not involved in the study. Stanford’s program beat dermatologists—essentially the world champions of skin cancer diagnostics, she says. “That’s pretty cool.” The study highlights the potential for #artificialintelligence #AI to enable anyone with a smartphone to have access to #healthcare. “We’re working towards extending the reach of care outside of the clinic,” says Andre Esteva, the electrical engineering PhD at Stanford who led the #study. Stanford built its #deeplearning algorithm on the architecture of the #GoogleNet Inception v3, a convolutional #neuralnetwork algorithm. Such programs are structured in interconnected layers that are inspired, at a high level, by the way #neurons in the #brain work. Inception v3 was trained on 1.28 million images from the 2014 ImageNet Large Scale #Visual Recognition Challenge, a contest that aimed to improve a computer’s ability to detect and classify objects in images. Stanford researchers then fine-tuned the algorithm with a set of nearly 130,000 images of #skin #lesions from more than 2000 #diseases—the largest dataset used for #automated skin cancer classification. In the study, the algorithm went head-to-head against 21 board-certified dermatologists. The #doctors reviewed hundreds of images of skin lesions, and for each one, determined whether they would conduct further tests on it or assure the patient that it was #benign. The algorithm reviewed the same images and gave its diagnoses. Neither the doctors nor the algorithm had seen the images previously. The computer performed on par with the experts. https://spectrum.ieee.org/static/ai-vs-doctors (at New York, New York)

#googlenet#benign#algorithm#doctors#deeplearning#skin#neurons#study#ai#university#visual#lesions#stanford#cancers#healthcare#skinlesions#neuralnetwork#dermatologists#brain#dermatologist#science#automated#health#photos#artificialintelligence#diseases#skincancer#nature

0 notes

Video

instagram

#東京スカイツリータウンキャンパス #StairLab #花分類 #ジギタリス #深層学習 #GoogleNet (東京スカイツリー / Tokyo Skytree)

0 notes

Text

Tackling IUU With Technology

IUU stands for Illegal, Unreported or Unregulated fishing. While many people in the developed world are completely unaware of illegal fishing, it does affect us all on many levels.

By some accounts, “nearly half of the fish sampled at roughly 10 percent of Los Angeles sushi restaurants were not what they were purported to be on menus.” The problem is not just Los Angeles.

In fact, mislabeled fish is only the tip of the iceberg. Illegal activities often coexist with mislabeled fish. It can be only a small step between illegal animal trafficking and drugs or people trafficking; between catching fish illegally and piracy and slavery on the high seas. If you want to know more about the problem, you can watch Vulcan Productions “Ocean Warriors.” Or, for a shorter read, this article provides insight into the links between IUU fishing and world-wide national security.

Scope of the problem

This post deals with a very narrow area – how Vulcan’s machine learning and computer vision team is using technology to detect illegal fishing activities.

Vulcan is addressing two different technical areas related to IUU fishing:

Identifying vessel type from satellite images.

Predicting vessel behavior based on vessel tracks.

Here we are focusing on our solution for vessel type identification in satellite images. In the future we will explain our approach to vessel behavior detection based on tracks.

Vessel classification

To achieve vessel classification we use a combination of machine learning (ML) and computer vision (CV) techniques. Below are some typical satellite images we are using for our work:

As you can see, it is not a trivial task to find objects in these images. In addition to image quality, typical problems include cloud cover and unrelated objects (such as airplanes or natural and man-made structures) in the frame:

Our process for detecting vessels in these images consists of several steps. First, we use a neural network to perform object detection, which identifies the bounding rectangle of the vessels in the image. After some experimentation, we achieved the best results using a fully convolutional neural network (FCN) with a network architecture based on GoogleNet, pre-trained on ImageNet. Below is the network topology:

It’s quite interesting to look at the resulting heat map of the network – it shows location of the vessel and gives coordinates of the bounding box:

At this stage, we have found the vessel, but we do not know the vessel type. The next step is to classify the vessel. Ideally, we would like to classify down to a sub-type of fishing vessels – e.g. trawlers, long liners, purse seiners, etc. Given the quality of the images, and constraints we had with training image set, we currently do not have the training data to support classification of vessel sub-types. As a first step, we focused on a simpler problem – performing a binary classification of fishing vs non-fishing vessels.

This first step of vessel classification is to orient the vessel horizontally. This simplifies the model, reduces the necessary amount of training data, and improves the model’s accuracy.

We use CV techniques to take the arbitrarily oriented vessels detected in satellite images and align them horizontally. The Line Segment Detector algorithm is used as starting point to detect straight line segments. Luckily, vessels have a large number of straight lines directed along the body of the ship. Using a kernel density estimation algorithm and histogram of directions, we detect the necessary angle required to rotate the image to horizontal position.

Once we have the detected vessel(s) in a horizontal position, and the whole image has a tight bounding box around it, we can significantly reduce the effort needed to train the classification model. We only need two permutations of a training image with the stern looking left and right. Otherwise we would have to create multiple permutations for many possible angles.

A horizontally oriented sub-image also helps to isolate objects when multiple vessels are directly adjacent.

Resulting image chips are sent to the classification network. Altogether, this approach yields impressive results. Our vessel detection accuracy has an F1 measure of 97.55%.

Conclusion

A fully convolutional network in conjunction with computer vision algorithms produce great results even when the input image quality is low. Using the fully convolutional network, we were able to achieve precision of 99.37% and recall of 95.80%, for a total of F1 measure of 97.55% on vessel detection in the satellite imagery. The next potential direction of research will include granular classification of fishing vessels by sub-type (e.g. trawler, purse seiner, etc). Eventually, with improved image resolution and a much larger corpus of annotated images detection of a specific vessel will be possible.

#computer vision#iuu#illegal fishing#machine learning#technology#Tech for good#satellite#convolutional neural networks#fishing vessel#googlenet#ocean health

0 notes

Text

For instance, GoogLeNet has multiple floppy ear detectors that appear to detect slightly different levels of droopiness, length, and surrounding context to the ears.

39 notes

·

View notes

Photo

High iters at high layers

0 notes